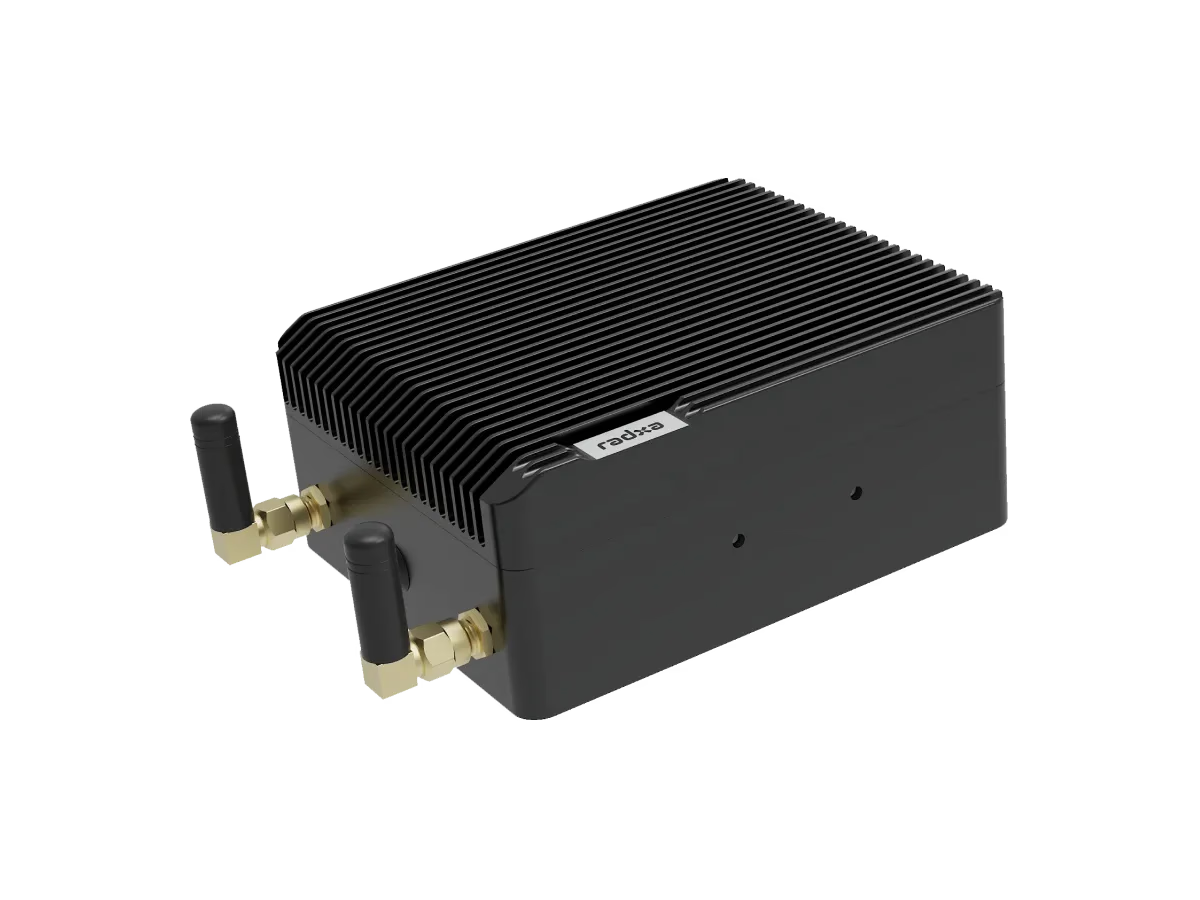

Fogwise AIRbox Q900:200TOPS級のエッジAIボックス

Radxa(Fogwise®)は2025年9月30日付で「Fogwise AIRbox Q900」の正式リリースを案内しました。Qualcomm Dragonwing IQ-9075搭載で最大200TOPS(INT8 sparse)のNPU性能を備え、36GB ECCメモリ・2.5GbE×2・SIM運用に対応した、現場で推論を完結させたい用途に刺さるエッジAIボックスです。

Orange PiがAscend 310を2基搭載した「OrangePi AI Studio Pro」を発表しました。AI算力352 TOPS、最大192GB LPDDR4Xという構成で、USB4(Type-C)経由でホストと接続する「AIボックス」として位置づけられています。SBCというよりは外付けAIアクセラレータの延長線上にある製品です。

Orange PiからOrangePi AI Studio Proが発表されました。昇腾社区(Powered by Ascend)の公式ページに製品情報が掲載されています。

本機はHuawei Ascend 310を2基搭載したAIボックスで、352 TOPSのAI算力と最大192GBのLPDDR4Xメモリを搭載しています。USB4(Type-C)経由でホストPCと接続し、AI推論処理をオフロードする「外付けAIアクセラレータ」に近い製品なんですよね。

SBCのようにGPIOやネットワークでセンサーを繋いで使うというより、ホスト側でネットワークやストレージを管理し、AI処理だけを本機に任せる運用が前提になりそうです。Jetson Orin NX(70〜100 TOPS級)では足りないけどデータセンターは大げさ、という中間層に刺さる製品ですね。

| ■ OrangePi AI Studio Pro | |

|---|---|

| AIプロセッサ | 昇腾(Ascend)310×2基(16 CPUコア・16 AIコア) |

| AI性能 | 352 TOPS |

| メモリ | LPDDR4X 96GB / 192GB(最大4266Mbps) |

| ローカルストレージ | SPI Flash 32MB×2 |

| 主要I/O | USB4(Type-C)1ポート |

| 電源 | DC 12V・20A(240W級、5.5×2.5mmジャック) |

| 冷却 | 12V 4Pinファン端子×2 |

| サイズ | 207.7×132.6×40mm(脚6mm) |

| 対応OS | Ubuntu 22.04.5(Kernel 5.15.0.126)、Windows(今後対応予定) |

Ascend 310×2基で352 TOPSというAI算力と、最大192GBのLPDDR4Xという大容量メモリをUSB4接続の筐体に収めた製品です。 ネットワークやストレージ拡張の一次情報は未確認で、USB4(Type-C)1ポートのみという割り切った構成ですね。導入前にI/O周りの詳細が公開されるかを確認しておきたいところです。

一次情報で明記されているのは、Huawei昇腾(Ascend)310を2基搭載し、合計352 TOPSのAI算力を実現している点です。CPU/AIコアは合計で16 CPUコア・16 AIコアという記載があります。

Ascend 310の正体:Huaweiが自社開発したAIアクセラレータで、Da Vinci(達芬奇)アーキテクチャを採用しています。クラウド向けのAscend 910に対して、Ascend 310はエッジ・推論向けに位置づけられています。12nmプロセスで製造され、単体で8/16 TOPSの性能を持つという公式仕様がありますが、本製品では2基で352 TOPSという表記なので、内部構成が通常のAscend 310とは異なる可能性がありますね。

| 製品 | AI性能(TOPS) | メモリ | 接続方式 | 価格帯 |

|---|---|---|---|---|

| OrangePi AI Studio Pro | 352 TOPS | 最大192GB LPDDR4X | USB4(Type-C) | 未公開 |

| NVIDIA Jetson AGX Orin | 275 TOPS | 64GB | オンボード | 約$2,000 |

| NVIDIA Jetson Orin NX | 70〜100 TOPS | 8〜16GB | M.2 | 約$400〜600 |

| Hailo-8 | 26 TOPS | ホスト依存 | M.2/USB | 約$100〜150 |

| Intel Movidius Myriad X | 4 TOPS | ホスト依存 | USB | 約$100 |

352 TOPSは競合を大きく上回る数値ですが、TOPSの算出条件(INT8/FP16/Sparse等)が一次情報で明記されていない点は注意が必要です。 Jetson AGX Orinの275 TOPSはSparse INT8での値ですし、単純な数値比較は避けたほうが安全ですね。

用途例としては、OCR、物体検知、顔認識、検索レコメンド、大規模言語モデル(多模態)などが公式ページで挙げられています。大容量メモリ(最大192GB)と組み合わせることで、LLMのような大きなモデルを載せた推論やマルチモデル並列処理に向いている構成です。Ascendのソフトウェアスタック「CANN(Compute Architecture for Neural Networks)」でモデルをデプロイする形になります。

メモリはLPDDR4X 96GBまたは192GBの2構成で、最大4266Mbpsの速度表記があります。エッジAIボードとしては異例の大容量で、LLMや複数モデルの常駐に余裕があるのがうれしいポイントです。 例えば70Bクラスのモデルを量子化せずに載せたい場合、このメモリ容量は大きな武器になりますね。

ローカルストレージはSPI Flash 32MB×2のみの記載で、OS領域の配置や更新手順は未確認。USB4経由でホスト側のストレージを使う運用が想定されている可能性がありますが、詳細は公式ドキュメント待ちです。

電源はDCジャック(5.5×2.5mm)で12V・20A、アダプタは240W級という記載です。消費電力帯からして、ファンによる能動冷却が必須の設計ですね。実際、12V 4Pinファン端子が2系統用意されています。

筐体には放熱スリットも見られるため、デスクトップ設置で十分なエアフローを確保する前提の製品です。ファンの騒音が気になる環境では注意が必要です。比較対象として、Jetson AGX Orinが60W程度なので、本製品の240W級はかなりの電力食いですね。

一次情報で確認できる「拡張」要素は、RGB灯インターフェースとファン端子のみです。

SBCでよく期待されるEthernet、Wi-Fi、Bluetooth、GPIO、M.2(NVMe/Wi-Fi用)、PCIeなどは未確認。USB4(Type-C)1ポートを通じてホスト側とやり取りする構成のため、ネットワークやストレージはホスト側で用意し、本機はAI処理専用として使う運用モデルが現実的です。

筐体サイズは207.7×132.6×40mm(脚6mm)で、卓上設置を前提とした「箱型」デバイスです。基板単体の写真は一次情報で確認できていませんが、筐体デザインからは産業用機器を意識したシンプルな外観が読み取れます。

ポート面やBOTTOM(下面)の画像は未確認のため、端子レイアウトの詳細は公開待ちです。

対応OSはUbuntu 22.04.5(Kernel 5.15.0.126)で、Windowsは「今後対応予定」と記載されています。

OSイメージのダウンロード場所や導入手順は未確認。SPI Flashがどのような役割を果たすのか(ブートローダーのみか、OS自体を格納するのか)も不明です。購入前に公式ドキュメントでセットアップ手順が公開されているか確認することをおすすめします。

Ascend向けのAI開発にはCANN(Compute Architecture for Neural Networks)というソフトウェアスタックが必要になります。PyTorch、TensorFlow、MindSporeなどのフレームワークからモデルを変換してデプロイする流れですね。

価格や入手方法は未確認。Orange Pi公式サイト(orangepi.org)やOrangePi中国サイト(orangepi.cn)での販売ページも、執筆時点ではアクセス障害により確認できませんでした。

OrangePi AI Studio Proは、Ascend 310×2基による352 TOPSと最大192GB LPDDR4Xという、エッジAIボード界隈では異例の構成を持つ「AIボックス」です。USB4(Type-C)1ポートでホストと接続し、AI処理をオフロードする用途に特化しています。

| 製品 | AI性能 | メモリ | 価格 |

|---|---|---|---|

| OrangePi AI Studio Pro | 352 TOPS | 最大192GB | 未公開 |

| NVIDIA Jetson AGX Orin 64GB | 275 TOPS | 64GB | 約$1,999 |

| NVIDIA Jetson AGX Orin 32GB | 200 TOPS | 32GB | 約$999 |

| NVIDIA Jetson Orin NX 16GB | 100 TOPS | 16GB | 約$599 |

| Hailo-8 M.2 Module | 26 TOPS | ホスト依存 | 約$150 |

※価格は参考値。OrangePi AI Studio Proの価格が公開され次第、競合との価格対性能比がわかります。

大きなモデル(70B級LLMなど)を載せた推論を外付けでやりたい人や、マルチモデル並列処理を高速化したい人には刺さる製品です。Ascendエコシステム(CANN)での開発に興味がある人にとっても、試す価値はあるでしょう。Jetson Orin NXでは足りないがデータセンターは大げさ、という中間層のワークロードには最適解になりそうです。

一方で、SBCのようにGPIOやEthernetを使ってセンサーを繋ぎたい人には向きません。また、NVIDIAやIntelのエコシステムに慣れていて乗り換えコストが気になる人や、静音環境で使いたい人(240W級ファン冷却)も注意が必要です。

公式ドキュメントでブート手順やI/O詳細が公開されるほど、評価が上がるタイプの製品です。続報を待ちたいところですね。

Radxa(Fogwise®)は2025年9月30日付で「Fogwise AIRbox Q900」の正式リリースを案内しました。Qualcomm Dragonwing IQ-9075搭載で最大200TOPS(INT8 sparse)のNPU性能を備え、36GB ECCメモリ・2.5GbE×2・SIM運用に対応した、現場で推論を完結させたい用途に刺さるエッジAIボックスです。

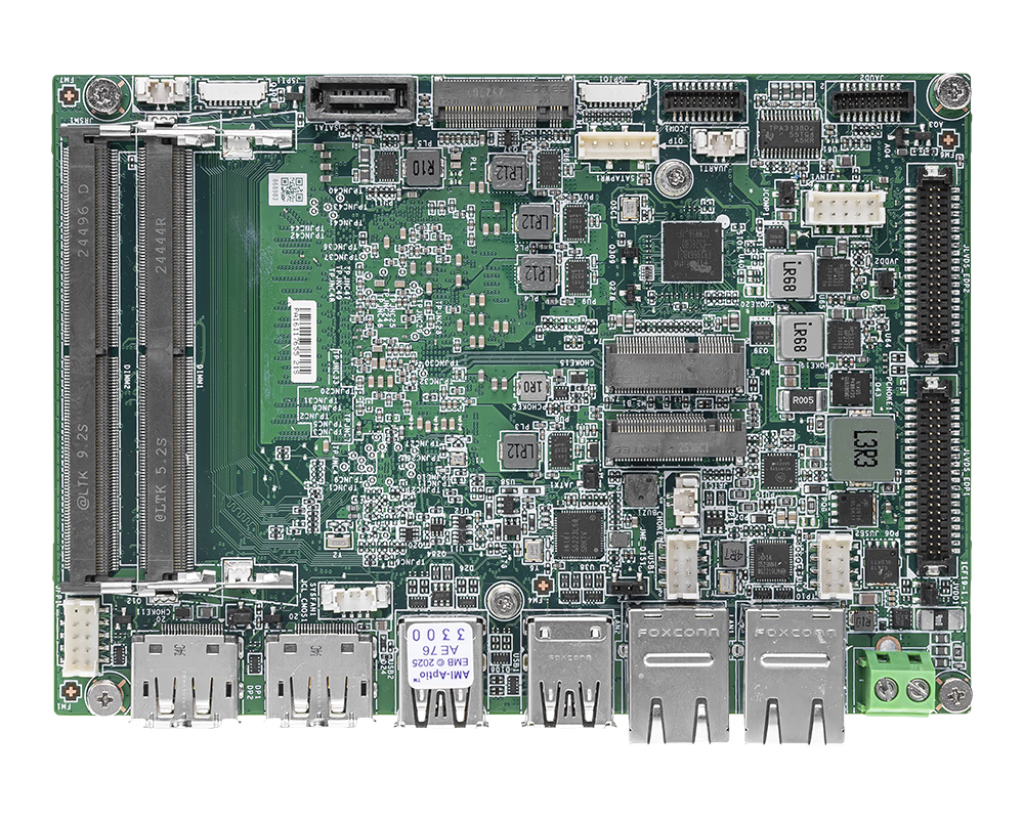

Advantechから登場した3.5インチSBC「MIO-5355」は、Qualcomm QCS6490を搭載し、本体サイズに似合わぬ強力なAI性能(12.3 TOPS)を持ちます。M.2スロット3基による拡張性と、産業グレードの信頼性が魅力です。

UP(AAEON)のUP Xtreme ARL AI Dev Kitは、Intel Core Ultra 5 225H+Arc 130T GPU+統合NPUで合計83 TOPSのAI演算性能を持つ開発キットです。Ubuntu Pro 24.04 LTS+AIソフトスイート、USB HDカメラ、256GB SSD同梱で、PoC立ち上げの初速が出やすい構成になっています。

MSI IPCの産業向け3.5インチSBC「MS-CF19」を紹介。Intel Core Ultra(100U/200U)対応でNPUを内蔵し、2.5GbEと1GbEのデュアルLAN構成。ファンレス運用を想定しつつ、M.2 NVMeやSATA×2のストレージ拡張にも対応しています。